يتغير البحث بشكل أسرع مما تستطيع معظم الشركات مواكبته. يتم استبدال اللعبة القديمة المتمثلة في مطاردة التصنيفات من خلال الكلمات الرئيسية بشيء أكبر: مساعدو الذكاء الاصطناعي الذين يفكرون ويتحدثون ويتصرفون نيابةً عن المستخدمين. هذا التحول هو ما نسميه التحسين التوليدي للمحركات، أو GEO. يتعلق الأمر بإعداد المحتوى والاستراتيجية الخاصة بك لعالم بالكاد يوجد فيه "مربع البحث"، ولكن لا يزال الاكتشاف هو الذي يقود النمو.

إعادة التفكير في الاكتشاف: البحث بالذكاء الاصطناعي أولاً وظهور GEO

يمر البحث بتحول غريب - من النوع الذي ليس له ما قبل وما بعد بشكل واضح. لم يعد الأمر يتعلق فقط بكتابة كلمات في مربع والتمرير عبر قائمة من الروابط. لقد تجاوزنا تلك الحقبة في الغالب.

ما يتبقى لدينا اليوم هو نسخة مزدحمة من جوجل مليئة بضبابية الذكاء الاصطناعي والإعلانات التي لا تتوقف، والمقتطفات التي تجيب عن سؤالك قبل أن تنقر، وشريحة متناقصة من النتائج العضوية الحقيقية. وفي الوقت نفسه، لا تتعامل منصات مثل ChatGPT وAI Mode مع البحث كوجهة على الإطلاق - إنها مجرد وظيفة واحدة داخل تجربة مساعد أوسع نطاقاً.

وبالنظر إلى المستقبل، فإن التحول أكثر دراماتيكية. قد يتوقف الناس عن "البحث" بالطريقة التي عرفناها. فبدلاً من فتح محرك البحث، سيكتفون بسؤال مساعد الذكاء الاصطناعي الخاص بهم - والسماح له بالبحث عنهم بهدوء. هذا التغيير ليس على بعد سنوات - إنه يتكشف بالفعل. فمع أدوات مثل Project Mariner وAstra من Google، إلى جانب التحركات الرئيسية من OpenAI وAmazon وMeta، فإننا نخطو إلى المرحلة التالية من الاكتشاف: مرحلة الذكاء الاصطناعي أولاً والمدعومة بما نسميه الآن تحسين التجربة التوليدية (GEO).

من التصنيفات إلى الأهمية: نهج NUOPTIMA GEO

في نوبتيما، نحن لا نتحدث فقط عن تحول الذكاء الاصطناعي - نحن نبني من أجله. إن التحسين التوليدي للمحرك (GEO) ليس اتجاهاً نطارده. إنه كتاب لعب قمنا بكتابته من خلال التجارب العملية والأبحاث الخاصة. بينما تهدف مُحسّنات محرّكات البحث إلى كسب الظهور من خلال التصنيفات، فإن GEO يتعلق بأن تصبح الإجابة نفسها - المحتوى الذي يسحبه الذكاء الاصطناعي عندما يستجيب لسؤال المستخدم.

يتمحور فريقنا حول هذا التحوّل. نحن ننشئ محتوى موثوقاً ومقروءاً بالذكاء الاصطناعي، ونحدد الاستعلامات ذات الأهداف العالية، ونتتبع المقاييس المهمة بالفعل في مشهد البحث الجديد هذا - أشياء مثل الاستشهادات المساعدة، وحركة المرور المباشرة من محركات الذكاء الاصطناعي، وتدفق العملاء المحتملين المدفوع بالمحتوى الذكي الذي يتم تحديد موقعه. إنها ليست نظرية. إنه تنفيذ مدعوم بالنتائج.

ليس من الصعب العثور علينا أيضاً. نشارك الأبحاث بصراحة، ونحن مستعدون دائمًا لإجراء محادثة - يمكنك التواصل معنا على لينكد إن.

الاكتشافات التي يقودها الذكاء الاصطناعي وواقع توقعات البيئة العالمية

لا يتعلق GEO، في شكله المتقدم، بالقواعد بقدر ما يتعلق بإدارة الاحتمالات. لا شيء يبقى ثابتاً لفترة طويلة. فالأنظمة التي تُشغّل البحث بالذكاء الاصطناعي لا تزال في حالة تغير مستمر، فما يعمل اليوم قد يتعطل بهدوء غداً.

هذا هو نوع المشهد الذي نتنقل فيه:

- في يوم من الأيام، لا تستطيع برامج زحف الذكاء الاصطناعي معالجة JavaScript، وفجأةً تستطيع.

- في أحد الأسابيع، يعتمد OpenAI على فهارس البحث الخاصة بجوجل وBing، وفي الأسبوع التالي يقوم بهدوء بإنشاء فهرسه الخاص به.

- في لحظةٍ ما، يكون موقعك الإلكتروني هو المنزل الأساسي للمحتوى الخاص بك - وفي اللحظة التالية، يكون مجرد مصدر بيانات لذاكرة الذكاء الاصطناعي.

لا توجد أرضية مستقرة. لكننا بدأنا نرى أنماطاً. وإذا كنت منتبهًا، يمكن أن تساعد هذه الإشارات في تشكيل الطريقة التي تعد بها المحتوى الخاص بك - وعملك - لما هو قادم.

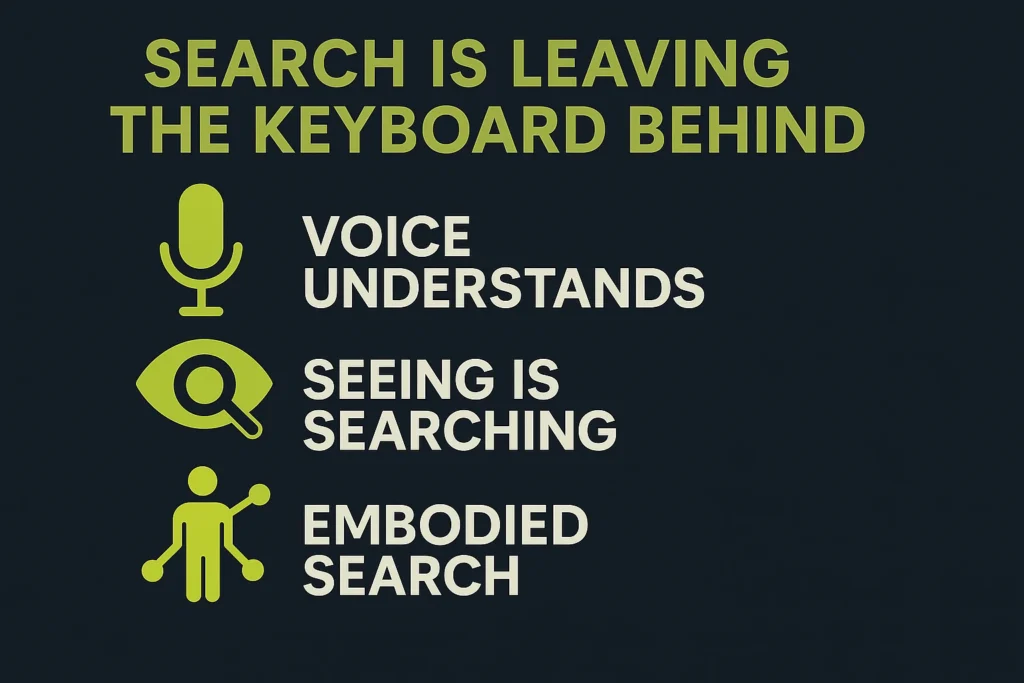

البحث يترك لوحة المفاتيح خلفه

يحدث واحد من أكبر التحولات في كيفية عثورنا على المعلومات بهدوء - نحن نتجاوز الكتابة. فبينما قضينا عقودًا من الزمن ونحن ملتصقون بلوحات المفاتيح، لطالما كانت الكتابة عنق الزجاجة. إنها ليست الطريقة التي نفكر بها. إنها أبطأ من التحدث أو الإشارة أو مجرد... النظر.

وهنا يأتي دور البحث الصوتي والمرئي وحتى البحث المجسد. لم تعد هذه أفكاراً مستقبلية بعد الآن - فهي تعيد بالفعل تشكيل كيفية تفاعل الأشخاص مع الذكاء الاصطناعي. قد تتحدث إلى مساعد، أو تريه ما تراه، أو تستخدم جهازاً قابلاً للارتداء يفسر العالم من حولك باستمرار في الوقت الفعلي.

صوت يفهم ولا يستجيب فقط

لطالما كان البحث الصوتي هو الشغل الشاغل في دوائر تحسين محركات البحث لسنوات، ولكن لنكن صادقين - فهو موجود في كل مكان بالفعل. سيري وأليكسا ومساعد جوجل - إنهم في منازل الناس وجيوبهم وسياراتهم. ما تغيّر هو أن الجيل التالي من الذكاء الاصطناعي يجعل الواجهات الصوتية أكثر ذكاءً وأكثر فائدة بكثير.

خذ مثلاً مشروع أسترا من جوجل. إنه ليس مجرد بحث صوتي - إنه حوار كامل. فهو يفهم اللهجات المختلفة، ويستجيب عبر 24 لغة، ويجري محادثة في الوقت الفعلي. هذه لعبة كرة قدم مختلفة.

هذا الجيل الجديد من التكنولوجيا الصوتية يجعل الأمور تبدو سهلة للغاية. يمكنك طرح أسئلة متعددة الطبقات ومفتوحة كما لو كنت تتحدث إلى شخص يفهمك بالفعل - والحصول على إجابة على الفور، مع إعادة التحدث مع السياق. أما تطبيق Alexa+ المحدث من أمازون فيأخذ الأمر إلى أبعد من ذلك. إنه ليس مجرد رد فعل - إنه محادثة. يمكنك التخطيط لجدولك الزمني، أو البحث عن المنتجات، أو مجرد الدردشة من خلال الأفكار، كل ذلك دون تحريك إصبعك.

عندما يكون الصوت مدعومًا بنماذج لغوية كبيرة، يتوقف البحث عن الشعور بأنه سطر أوامر ويبدأ في الشعور بأنه أشبه ما يكون بتبادل الأفكار مع صديق ذكي.

الرؤية هي البحث

يسير البحث المرئي في نفس الاتجاه. لقد وصلنا بالفعل إلى مرحلة يمكنك فيها توجيه هاتفك - أو زوج من النظارات الذكية - إلى شيء ما والسؤال عن ماهيته. تبذل Google جهوداً كبيرة في هذا المجال: يمكن للعدسة بالفعل التعرف على الأشياء وقراءة النصوص من الصور وترجمة الإشارات في الوقت الفعلي. ولكن مع مشروع أسترا، تصبح الأمور أكثر ديناميكية.

باستخدام Astra في وضع "البث المباشر"، يمكنك الضغط على زر والسؤال عن أي شيء في بث الكاميرا - يرى الذكاء الاصطناعي ما تراه ويستجيب على الفور. اسأل عن مبنى، أو منتج، أو حتى عن وصفة تطبخها - وسيبدأ في الرد عليك بالإجابات في الوقت الفعلي.

لم يعد الاكتشاف محصوراً في الشاشات وأشرطة البحث، بل بدأ يحدث في العالم الحقيقي. تخيل هذا: أنت تنظر إلى مبنى، فتخبرك نظارتك الذكية بخلفيته. أو تقوم بمسح أحد المنتجات على أحد الأرفف، فيسحب لك الذكاء الاصطناعي المراجعات ومقارنات الأسعار، وربما ينبهك إلى صفقة أفضل في مكان قريب. لقد بدأ البحث يعمل من خلال النظر، وليس فقط من خلال النص.

كيف يبدو البحث المجسد

هذا ما يبدو عليه البحث المجسد. لا يتعلق الأمر فقط بالصوت أو المرئيات - بل يتعلق بأن يكون مساعدك على دراية بما يحيط بك. أجهزة مثل نظارات الواقع المعزز تجعل ذلك ممكناً. يمكن للنموذج الأولي من Google، الذي انبثق من عمل مشروع Astra، عرض العالم من وجهة نظرك ووضع معلومات مفيدة على ما تراه مباشرةً - في الوقت الفعلي.

في هذا الإعداد، الذكاء الاصطناعي ليس أداة تستعين بها - بل هو أشبه بمساعد طيار يتحرك معك. يمكنه أن يصف لك ما هو أمامك، أو يرشدك خلال مهمة ما، أو حتى يتدخل لتقديم الدعم عند الحاجة. فكّر في مستخدم ضعيف البصر يحصل على تنبيهات بشأن العقبات أثناء المشي، أو شخص يطهو وصفة جديدة يحصل على تعليمات المكونات بدون استخدام اليدين أثناء التنقل. إنه البحث الذي يظهر في لحظتها - دون الحاجة إلى طلب ذلك مرتين.

كل هذه الطرق الجديدة للتفاعل - التحدث، والعرض، والمسح الضوئي - تدفع محركات البحث إلى منطقة غير مألوفة. فهي مجبرة على فهم أكثر من مجرد النص.

ولمواكبة ذلك، تحتاج أنظمة البحث الآن إلى تفسير الصور والفيديو والصوت وحتى المدخلات ثلاثية الأبعاد بنفس طلاقة اللغة. بالنسبة إلى مُحسّنات محرّكات البحث والمسوّقين، هذا تحوّل حقيقي. لم يعد يكفي تحسين العناوين والبيانات الوصفية. عليك الآن أن تفكر في كيفية أداء المحتوى الخاص بك عند قراءته بصوت عالٍ، أو رؤيته من خلال عدسة، أو عند وضعه في الواقع المعزز. إذا لم يتمكن مساعد الذكاء الاصطناعي من الوصول إليه بدون شاشة، فإنك تخاطر بتخطيه تماماً.

واللاعبون الكبار يضاعفون بالفعل من هذا الأمر. تعمل Google على تعزيز البحث المرئي باستخدام Lens و Project Astra. تعمل أمازون على جعل Alexa أكثر ذكاءً من وراء الكواليس، مما يتيح لها التنقل عبر صفحات الويب والتطبيقات نيابة عنك. وتجرب Meta البحث الذي يعمل من خلال تطبيقات المراسلة الخاصة بها - مثل Instagram أو WhatsApp - حيث يمكنك أن تطلب من الذكاء الاصطناعي العثور على مكان لتناول الطعام في مكان قريب، مباشرةً داخل سلسلة محادثات.

لم يعد البحث مكتوبًا فقط بعد الآن. بل يتم التحدث به وإظهاره واستشعاره. الأجهزة من حولنا - الهواتف والنظارات والأجهزة القابلة للارتداء - أصبحت بهدوء الأبواب الأمامية الجديدة للبحث. احتكاك أقل، وتدفق أكثر.

البحث الشخصي المفرط: عندما يعرفك الذكاء الاصطناعي جيداً

دعنا نكون صادقين - ما مقدار بياناتك الشخصية التي ترغب حقًا في تسليمها للحصول على نتائج بحث أكثر ذكاءً و"فائدة"؟

هذه واحدة من المفاضلات الكبيرة القادمة بسرعة. يتعلق البحث المستقبلي بالدقة، وتعتمد هذه الدقة على مدى معرفة الذكاء الاصطناعي بك. نحن نتجاوز مجرد استهداف الموقع الجغرافي أو تذكر آخر استفساراتك القليلة. والآن، تقوم محركات البحث ببناء ملفات تعريف كاملة للمستخدمين - من تفضيلاتك وسلوكياتك ومحادثاتك السابقة وحتى صندوق الوارد الخاص بك - لتوليد إجابات تبدو وكأنها كُتبت خصيصاً لك.

ولا أحد في وضع أفضل من Google للقيام بذلك. فمع سنوات من البيانات من البحث وGmail وGmail والخرائط وYouTube وAndroid، فهي تعرف بالفعل عن حياتك الرقمية أكثر مما يشعر معظم الناس بالراحة للاعتراف به. وعلى الرغم من الضغوط التي تمارسها الجهات التنظيمية، لا يوجد ما يشير إلى أن هذه القبضة ستخف في أي وقت قريب.

هذا المستوى من التخصيص يغير طريقة عمل الاستعلامات. اسأل شيئًا بسيطًا مثل "ماذا يجب أن أعدّ للعشاء؟ - وقد يتذكّر الذكاء الاصطناعي أنك في الأسبوع الماضي تناولت وصفات الشواء، وشاهدتَ أحد مشاهير مدينة كانساس سيتي على يوتيوب، وتركتَ تقييمًا من فئة الخمس نجوم لصلصة حارة. وبدلاً من الاقتراحات العامة، يمكن أن يوصيك بنسخة نباتية من طبق نباتي من المحتمل أن تحبه، مأخوذة من مقطع فيديو يعرف بالفعل أنك ستشاهده.

مريحة؟ بالتأكيد. مخيف؟ يعتمد على من تسأل.

هذا النوع من إضفاء الطابع الشخصي المفرط ليس أثرًا جانبيًا، بل هو الهدف. فمشروع أسترا من Google، على سبيل المثال، مصمم لتعلم عاداتك وتفضيلاتك وخياراتك السابقة حتى يتمكن من تشكيل الردود حول ما يهمك بالفعل. فهو يتذكر ما إذا كانت لديك قيود غذائية، أو إذا كنت تميل إلى تفضيل علامات تجارية معينة، أو إذا كنت قد أبدت اهتمامًا بمنتج ما بالفعل. أنت لا تحصل على نتيجة بحث فحسب، بل تحصل على إجابة تتوافق مع أسلوبك.

من غيرك يقوم ببناء هذا؟

OpenAI أيضاً في هذا المجال. فمنذ عام 2024، استخدمت ChatGPT تعليمات وذاكرة مخصصة للتكيف مع المستخدمين الأفراد بمرور الوقت. إنه يلتقط

- نبرة صوتك وصياغتك

- المواضيع المفضلة.

- الطريقة التي تكتب بها

لذا عندما يطرح شخصان نفس السؤال، قد يحصلان على إجابات مختلفة تماماً. إذا كنت قد أظهرت تفضيلك للأدوات مفتوحة المصدر عند البحث عن أدوات إدارة علاقات العملاء، على سبيل المثال، فإن ChatGPT يتذكر ذلك ويقوم بتصفية نتائج البحث المستقبلية لتتناسب مع ذلك. الأمر أقل شبهاً بالاستعلام عن قاعدة بيانات وأكثر شبهاً باستشارة مساعد بحث يعرف قواعد اللعبة الخاصة بك.

تعمل أليكسا+ من أمازون على الترويج للفكرة نفسها في المنزل. إنه يتذكر:

- تاريخ الشراء.

- الذوق الموسيقي.

- مصادر الأخبار

- حتى أعياد الميلاد العائلية (إذا كنت قد أخبرتها).

لنفترض أنك طلبت فكرة عشاء عائلي: لن تكتفي أليكسا بطرح وصفات عشوائية. بل سيأخذ في الاعتبار النظام الغذائي النباتي لابنتك، وحساسية شريكك من الغلوتين، ويقترح عليك شيئاً يمكن للجميع تناوله بالفعل. وتصبح نتائج البحث أشبه بإجراءات مصممة خصيصاً - كونسيرج شخصي يكون دائماً على اطلاع دائم.

وفي الوقت نفسه، تمتلك Meta مجموعة هائلة من البيانات الشخصية من منصاتها - وقد بدأت في استخدام هذه البيانات. تشير التقارير إلى أنها تقوم ببناء محرك بحث مدعوم بالذكاء الاصطناعي يتصل مباشرةً بنظامها البيئي. وهذا يعني:

- إذا كنت تستخدم واتساب أو إنستجرام، يمكن للذكاء الاصطناعي الخاص ب Meta الاستفادة من الرسم البياني الاجتماعي وعادات التصفح وسجل المشاركة.

- قد تعتمد اقتراحات المطاعم على المكان الذي ذهب إليه أصدقاؤك.

- يمكن ضبط الأخبار على الصفحات التي تتابعها.

إنه نوع من التخصيص الذي يبدو سلسًا عندما يعمل - ولكنه يأتي مع مقايضات. الراحة كبيرة. والمخاوف المتعلقة بالخصوصية أيضاً. ومع ذلك، هذا هو الاتجاه الذي تسير فيه الأمور. في المستقبل القريب، لن يتوقع المستخدمون في المستقبل القريب إجابات ذات صلة فحسب - بل سيتوقعون إجابات تبدو وكأنها كُتبت خصيصًا لهم.

بالنسبة لفرق تحسين محركات البحث وفرق المحتوى، فإن هذا يقلب قواعد اللعبة. فأنت لم تعد تعمل على التحسين من أجل "مستخدم عادي" واسع النطاق. أنت تحاول وضع المحتوى أمام ذكاء اصطناعي يقوم بتصفية كل شيء من خلال عدسة شخصية - مستخدم واحد في كل مرة. وهذا يعني إنشاء محتوى يخاطب بوضوح الاحتياجات المتخصصة، أو سلوكيات محددة، أو شخصيات محددة جيدًا. سوف يتلاشى المحتوى العام في الضوضاء.

كما أنه يزيد من مخاطر الثقة. إذا كان المستخدمون سيسمحون للمساعدين بالتعمق في حياتهم الشخصية، فيجب أن تكون العلامات التجارية جديرة بهذه الثقة. ولكن إذا فهمت الأمر بشكل صحيح - إذا كان المحتوى الخاص بك يتماشى مع الملف الشخصي الصحيح، في الوقت المناسب - يصبح البحث بالذكاء الاصطناعي أقل من لعبة ترتيب وأكثر من محرك توصية واحد لواحد. نتيجة واحدة مصممة خصيصاً لهم.

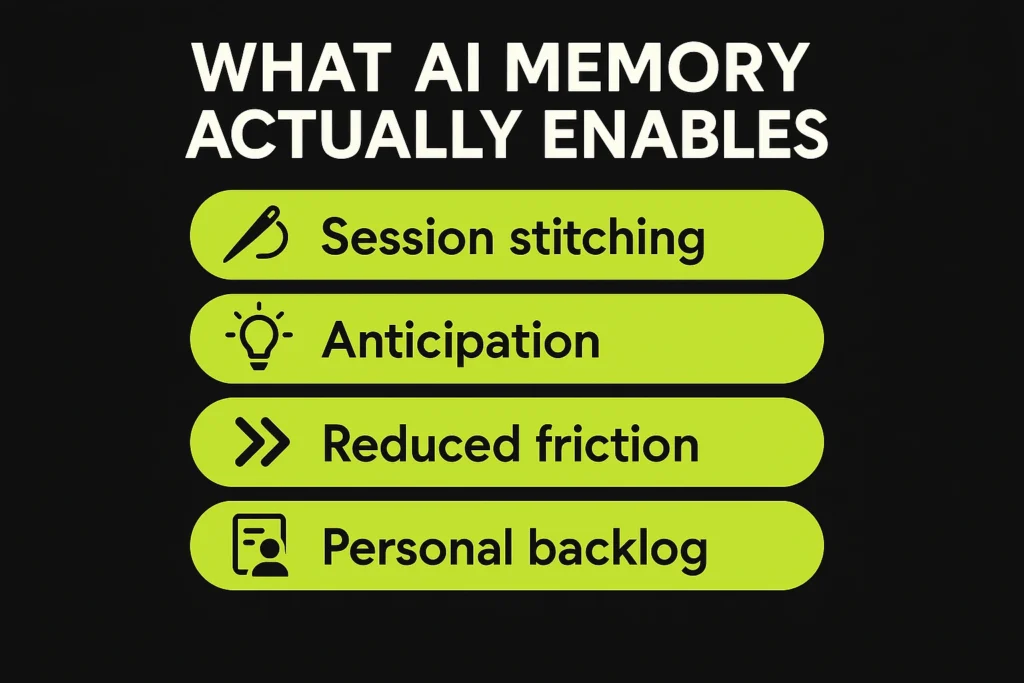

ذاكرة الذكاء الاصطناعي: عندما يتوقف البحث عن النسيان

التخصيص هو نصف القصة فقط. أما النصف الآخر فهو الذاكرة، وهي تتحول بهدوء إلى سمة أساسية في كيفية تطور البحث بالذكاء الاصطناعي.

تبدأ محركات البحث التقليدية من جديد في كل مرة. طرح سؤال، والحصول على النتائج، وإغلاق علامة التبويب، وينتهي الأمر. لكن مساعدو الذكاء الاصطناعي لا يعملون بهذه الطريقة. إنهم يتعلمون التذكر. سيحتفظ الذكاء الاصطناعي المستقبلي بالسياق ليس فقط في جلسة واحدة، ولكن عبر جميع الجلسات - عبر الأجهزة، وحتى عبر أسابيع أو أشهر.

نحن نرى بالفعل العلامات الأولى. على سبيل المثال، يمكن لـ ChatGPT إجراء محادثة تعتمد على نفسها، وتتذكر ما قلته قبل خمس مطالبات. ولكن هذا مجرد سياق على مستوى الجلسة. ما سيأتي بعد ذلك أعمق وأطول أجلاً. يختبر مشروع أسترا من جوجل بالفعل هذا النوع من الاستمرارية - الذاكرة التي تتبعك من الهاتف إلى النظارات الذكية، والتي تتذكر ما سألته بالأمس أو الشهر الماضي، وتجلب تلك المعرفة إلى التفاعل التالي.

إنه الفرق بين طرح سؤال وإجراء محادثة مستمرة. قد تقول: "ما هو ذلك المكان التايلاندي الذي بحثت عنه قبل بضعة أسابيع؟" وسيعرف مساعدك بالضبط ما كنت تقصده. لأنه يتذكّر ما بحثت عنه وما تخطيته وما كدت تحجزه. هذا ليس ذكاءً فحسب، بل هو انتباه.

ما الذي تتيحه ذاكرة الذكاء الاصطناعي في الواقع

- خياطة الجلسات: الذاكرة الدائمة التي تنتقل عبر التطبيقات والأجهزة والوقت.

- التوقع وليس رد الفعل: يمكن للذكاء الاصطناعي التصرف قبل أن تسأل، بناءً على سلوكك السابق.

- تقليل الاحتكاك: لا مزيد من التكرار عبر الجلسات أو التطبيقات.

- الاستدعاء الشخصي المتراكم: يُظهر الذكاء الاصطناعي عمليات البحث السابقة أو النتائج التي تم تخطيها عندما تصبح ذات صلة.

- تخصيص أعمق: توصيات تتطور مع تغير تفضيلاتك.

- أتمتة مدركة للسياق: تذكُّر المهام غير المنجزة وتنبيهك لاحقاً.

من الذاكرة إلى الزخم: كيف يبدأ الذكاء الاصطناعي في التصرف بناءً على ما يتذكره

عندما يتذكر الذكاء الاصطناعي، فإنه لا يستجيب فقط - بل يبدأ في التوقع. هنا تصبح الأمور مثيرة للاهتمام. فبدلاً من انتظار أن تطلب شيئاً ما، يمكنه التدخل قبل أن تدرك أنك بحاجة إلى المساعدة.

لقد ألمحت أمازون بالفعل إلى هذا التحول مع Alexa+. فقد يطالبك بالمغادرة في وقت مبكر إذا كان هناك ازدحام مروري في طريقك إلى اجتماعك، أو قد يخبرك بأن سماعات إلغاء الضوضاء التي نظرت إليها الأسبوع الماضي قد انخفض سعرها للتو. إنه بحث يتحول إلى دعم - وهو يحدث في الوقت الفعلي.

تتحرك Google بنفس الطريقة. لقد حدد سوندار بيتشاي رؤية يتتبع فيها مساعدو الذكاء الاصطناعي الذاكرة طويلة المدى عبر الجلسات والمهام والأجهزة. لذا، إذا كنت تخطط لرحلة ما وعدت بعد شهر تطلب حجز نفس الوجهة في فصل الربيع، فلن يحتاج مساعدك إلى القصة الكاملة - فهو يعرف بالفعل.

ويعني هذا النوع من الذاكرة أن المستخدمين لن يحتاجوا إلى تكرار ما يقومون به. يلتقط المساعد من حيث توقفت - سواء كان ذلك استعلاماً عن التسوق، أو مشروعاً طويلاً، أو مجرد التخطيط للعشاء. إنه يحول البحث إلى شيء مستمر - لا يتعلق بالإجابات في الوقت الراهن، بل يتعلق أكثر بالفهم مع مرور الوقت.

وبالنسبة لفرق المحتوى، فإن هذا التحول يغير القواعد. قد يصل المستخدم إلى صفحتك مرة واحدة، ولكن هذا التفاعل قد يتردد صداه لفترة طويلة بعد ذلك. إذا قام مساعد الذكاء الاصطناعي بتخزين تلك المعلومات - دليل، أو مراجعة، أو تفاصيل المنتج - فيمكنه إعادة عرضها لاحقًا عند الحاجة إليها بالفعل. ليس عندما يبحث شخص ما، ولكن عندما يكون السياق مناسباً.

وهذا يفتح نوعًا جديدًا من الفرص: المحتوى الاستباقي. ربما سأل شخص ما عن صيانة السيارة منذ أشهر - والآن حان وقت تغيير الزيت، ويقدم الذكاء الاصطناعي تذكيراً مع مقتطف مفيد من موقع علامتك التجارية. لم تأتِ هذه اللحظة من نية البحث. بل جاءت من الذاكرة.

في هذا النموذج، لا تتعلق الملاءمة بالكلمات المفتاحية فقط، بل تتعلق بالتوقيت والسياق والثقة. إذا كان المحتوى الخاص بك يستحق التذكر، فقد يعيد الذكاء الاصطناعي تشغيله. هذه لعبة مختلفة تماماً عن تلك التي كنا نلعبها مع محركات البحث المنسية اليوم.

جعل أنظمة الذكاء الاصطناعي تتحدث: لماذا يعتبر برنامج الذكاء الاصطناعي المختلط مهمًا

مع بدء مساعدي الذكاء الاصطناعي في التعامل مع مهام أكثر تعقيداً، لا يمكنهم العمل في صوامع. فهم بحاجة إلى الحصول على البيانات من أماكن مختلفة، واستخدام أدوات خارجية، وحتى التعاون مع أنظمة الذكاء الاصطناعي الأخرى. وهنا يأتي دور بروتوكول سياق النموذج (MCP) - وهو معيار جديد مصمم لمساعدة الذكاء الاصطناعي المختلفة على التحدث بنفس اللغة ومشاركة ما يعرفونه.

فكر في MCP على أنه البرنامج الوسيط الذي يتيح لأدوات الذكاء الاصطناعي المزامنة. فهي تسمح للمساعدين بسحب السياق المباشر من التطبيقات أو قواعد البيانات أو أنظمة المحتوى الأخرى - والاستفادة منها فعلياً في الوقت الفعلي. وهذا أمر مهم لأي شيء يتعلق بالبحث أو تنفيذ المهام. فبدلاً من تقديم إجابات ثابتة وعامة، يمكن للذكاء الاصطناعي الاستفادة من قاعدة المعرفة في شركتك، أو أدوات إدارة مشروعك، أو حتى لوحات المعلومات الداخلية الخاصة بك لتقديم استجابة مخصصة.

من الإجابات الثابتة إلى التكامل المباشر

تم تقديم البروتوكول نفسه من قبل أنثروبيك لاختراق الإعداد النموذجي للحديقة المسورة الذي تعلق فيه معظم أنظمة الذكاء الاصطناعي. عادة، يتطلب دمج الذكاء الاصطناعي مع أدواتك تطويراً مخصصاً. يهدف MCP إلى توحيد هذه العملية. باستخدامه، يمكن للمساعد أن يتصل بأمان بمجموعة من الأدوات ويحمل السياق عبرها.

- الفكرة: لاسترداد الوثائق في الوقت الفعلي، أو ملاحظات الاجتماعات، أو مواصفات المنتج.

- جيرا للتحقق من حالات المشكلات، أو السباقات، أو العوائق، أو تقدم النشر.

- جوجل درايف: لسحب أحدث جداول البيانات أو التقارير أو مسودات العمل.

- سلاك لفهم مناقشات الفريق الأخيرة أو الأسئلة التي لم يتم حلها.

- CRMs أو لوحات معلومات التحليلات: لجلب بيانات العملاء أو مقاييس الاستخدام أو مؤشرات الأداء الرئيسية.

اسأل، "ما هي حالة المشروع X؟" وبدلاً من التخمين أو إعطاء إجابة مبهمة، يمكن لمساعدك التحقق من Notion أو Jira أو Google Drive الخاص بفريقك وإرجاع التحديث الفعلي - مع تضمين السياق.

إن MCP لا يتعلق بالوميض. إنها بنية تحتية - من النوع الذي يجعل الذكاء الاصطناعي يعمل بشكل أكثر ذكاءً خلف الكواليس. وبالنسبة لأي شخص يقوم ببناء محتوى جاهز للبحث أو خدمات ممكّنة للبحث، فهي إشارة إلى أن المستقبل لا يتعلق فقط بالرؤية. بل يتعلق الأمر بأن تكون جزءاً من النظام البيئي الذي يسحب منه الذكاء الاصطناعي عندما يحتاج إلى شيء موثوق به.

الصورة الأكبر: السياق المستمر والنظم الإيكولوجية المفتوحة

ما يجعل برنامج MCP مثيرًا للاهتمام بشكل خاص ليس فقط أنه يربط الأنظمة - فهو يفعل ذلك في كلا الاتجاهين، ويتذكر. لا يكتفي المساعد بالحصول على البيانات عند الطلب، بل يمكن لتلك الأدوات المتصلة أن ترسل تحديثات بشكل نشط. وهذا يمنح الذكاء الاصطناعي سياقاً حياً ومتطوراً باستمرار للعمل من خلاله.

تخيل سؤالك "ماذا يجب أن أفعل اليوم؟ يمكن أن يسحب الذكاء الاصطناعي الخاص بك اجتماعاتك من التقويم، ويتحقق من حالة الطقس في موقعك، ويكشف لك عن خبر عاجل في مجال عملك - ويربط كل ذلك معاً في إجابة واحدة مخصصة. يصبح هذا النوع من التوليف ممكناً لأن MCP يبقي المساعد متصلاً بكل شيء - ليس مرة واحدة فقط، بل باستمرار.

تعمل هذه الذاكرة الديناميكية والوصول إلى الأدوات عبر الأنظمة على تغيير تجربة البحث تمامًا. فأنت لم تعد تتعامل مع استعلامات غير متصلة ونتائج ثابتة. أنت تستفيد من مساعد يفهم الصورة الأكبر ويتكيف معها في الوقت الفعلي.

كما أن هناك أيضاً لعبة أكبر هنا - فالمعايير المفتوحة مثل MCP تمنعنا من أن ينتهي بنا المطاف بعشرات من أنظمة الذكاء الاصطناعي المنغلقة والمنعزلة. وهذا يعني أن مساعد Google الخاص بك يمكنه التحدث إلى الذكاء الاصطناعي في سيارتك، أو إلى الروبوت الداخلي لشركتك، وسيتشاركون جميعاً السياق ذي الصلة دون الحاجة إلى عمليات تكامل مخصصة.

في المستقبل، من المرجح أن نرى وكلاء يمكنهم التفويض عبر الشبكات. قد يقوم الذكاء الاصطناعي الشخصي الخاص بك بتمرير استعلام قانوني إلى وكيل بحث متخصص، وانتظار النتائج، ثم تجميع النتائج في ملخص نظيف - دون الحاجة إلى تنسيقها يدويًا. هنا يأتي دور بروتوكول A2A (من وكيل إلى وكيل) من Google - سنتطرق إلى ذلك بعد ذلك - ولكن الفرق الرئيسي هو هذا: يتعلق بروتوكول MCP بربط البيانات والأدوات داخل سير عمل وكيل واحد. بينما A2A يتعلق بتعاون الوكلاء عبر الحدود.

عند استخدامهما معاً، فإنهما يفتحان شيئاً أكبر من ذلك بكثير: عالم لا يكتفي فيه وكلاء الذكاء الاصطناعي بالإجابة عن الأسئلة فحسب، بل يقومون بتنسيق مهام كاملة خلف الكواليس، ويستفيدون من أدوات ومصادر متعددة، كل ذلك نيابةً عنك.

وكلاء الذكاء الاصطناعي الذين يتحدثون مع بعضهم البعض: بروتوكول A2A من جوجل

لجعل مساعدي الذكاء الاصطناعي أكثر ذكاءً وفائدة، تقوم Google ببناء السباكة التي تتيح لهم العمل معاً، ليس فقط مع الأدوات، ولكن مع بعضهم البعض. تم طرح هذا البروتوكول الجديد، المسمى A2A (وكيل إلى وكيل)، في أوائل عام 2025 كمعيار مفتوح مصمم للسماح لوكلاء الذكاء الاصطناعي المختلفين بالتعاون عبر الأنظمة ومقدمي الخدمات.

بينما يربط MCP مساعد واحد بالبيانات أو الأدوات، فإن A2A يربط بين وكلاء كاملين - حتى لو تم إنشاؤهم من قبل شركات مختلفة. الأمر أشبه بجلب فريق من الخبراء بدلاً من الاعتماد على خبير واحد. وهذا يعني أنه يمكن تقسيم المهام المعقدة وتفويضها وتنفيذها بالتوازي خلف الكواليس.

كيف يعمل A2A: من التفويض إلى التنفيذ

إليك ما يبدو عليه ذلك عملياً: لنفترض أنك تخبر الذكاء الاصطناعي الخاص بك، "خطط لرحلتي في عطلة نهاية الأسبوع واحجز كل ما أحتاجه". هذه ليست مهمة واحدة - إنها سلسلة من المهام. يمكن لمساعدك أن يتواصل مع الذكاء الاصطناعي لوكيل السفر للعثور على رحلات الطيران والفنادق وحجزها. وفي الوقت نفسه، يمكنه الاتصال بوكيل مطعم محلي لحجز حجوزات العشاء. وربما حتى الاتصال بوكيل يركز على الصفقات لتطبيق أي خصومات. يعمل كل وكيل من هؤلاء الوكلاء على الجزء الخاص به، ويرسل التحديثات مرة أخرى، ويقوم مساعدك الرئيسي بتجميع الأجزاء في مسار رحلة واحد نظيف.

يجعل A2A كل ذلك ممكناً من خلال إنشاء بروتوكول مشترك. يعلن الوكلاء عن ما يمكنهم القيام به، ويرسلون ويستقبلون "مهام" منظمة، ويتبادلون السياق أو النتائج - التي تسمى "القطع الأثرية" - بطريقة تجعل التعاون بدون احتكاك.

لا يتعلق الأمر فقط بالبحث الأكثر ذكاءً. إنه يتعلق ببناء أنظمة ذكاء اصطناعي يمكنها التفكير وتقسيم العمل وتقديم حلول كاملة بدلاً من الإجابات المعزولة. وهو قادم بسرعة.

إن دفع Google لـ A2A يوضح أمرًا واحدًا: لن يتقن نموذج واحد للذكاء الاصطناعي كل شيء. فبدلاً من محاولة بناء مساعد واحد ضخم يقوم بكل شيء، يبدو المستقبل أشبه بشبكة من الوكلاء المتخصصين - كل منهم يتعامل مع ما يجيده، ويعملون معاً عند الحاجة.

A2A ومستقبل البحث والمحتوى

بالنسبة للبحث، يعد هذا تغييراً جذرياً. يمكن الآن تقسيم الاستعلامات المعقدة - تلك التي تشمل مهام متعددة - وتفويضها. لنفترض أنك تسأل، "ساعدني في شراء منزل، والتفاوض على السعر، وإعداد الإنترنت." هذه ثلاث عمليات سير عمل منفصلة. يتيح A2A لمساعدك الرئيسي أن يقوم مساعدك الرئيسي بإدخال ذكاء اصطناعي للوكيل العقاري، وذكاء اصطناعي للعقود القانونية، وذكاء اصطناعي لإعداد الإنترنت - كل يقوم بدوره ثم يمرر النتائج مرة أخرى للحصول على استجابة واحدة متماسكة.

يمنحهم البروتوكول لغة مشتركة وبنية مشتركة للعمل ضمنها - كيفية العثور على بعضهم البعض، وكيفية التواصل مع التحديثات، وكيفية إرجاع المعلومات بتنسيقات متوافقة. إنه بحث تعاوني مدعوم بالأتمتة.

والأمر ليس مجرد نظرية. لقد استقطبت Google بالفعل أكثر من 50 شريكًا - شركات برمجيات وشركات ناشئة ومنصات - للمساعدة في بناء هذا الأمر. يتم الإشراف عليها كمبادرة مفتوحة من قبل مؤسسة Linux Foundation، مما يعني أنها ليست حديقة مسورة. بل يتم بناؤه على نطاق واسع.

قريبًا، سنرى قريبًا مساعدين يحللون سؤالاً مثل "كيف يمكنني تنمية تواجدي على الإنترنت؟" من خلال سحب الرؤى من وكيل استراتيجية المحتوى ووكيل تحسين محركات البحث ووكيل تحليلات الويب - لكل منهم بياناته وأدواته ومنطقه الخاص - ثم تجميع المخرجات في إجابة واحدة واضحة. لن ترى عملية التسليم. ستحصل فقط على الرؤى.

الصورة الأكبر؟ هذا يكسر صوامع المنصات. يمكن للذكاء الاصطناعي من Apple أن يمرر طلباً إلى وكيل Google أو OpenAI عندما يكون ذلك منطقياً - والعكس صحيح. قد يطلب مساعد سيارتك من مساعدك المنزلي التحقق من شيء ما على كمبيوتر عملك. يحدث كل هذا التنسيق من خلال A2A.

إذا كنت تعمل في مجال التسويق أو التكنولوجيا، فإليك ما يعنيه ذلك: لن يتم استهلاك المحتوى الخاص بك من قبل الأشخاص فقط بعد الآن. سوف يستهلكه الوكلاء - وهؤلاء الوكلاء يحتاجون إلى واجهات برمجة تطبيقات نظيفة وبيانات منظمة ونقاط نهاية يمكن الوصول إليها. إذا لم يكن منتجك أو محتواك جاهزًا ل A2A (أو جاهزًا ل MCP)، فقد لا يكون حتى في السباق عندما يقوم الذكاء الاصطناعي بإنشاء استجابة.

هذا هو تحسين محركات البحث الذي يتطور إلى شيء أعمق. لا يتعلق الأمر بالترتيب - بل يتعلق أكثر بكونه مفيدًا وسهل الوصول إليه وقابل للقراءة الآلية على نطاق واسع.

البحث متعدد الوسائط هنا - والجميع يتسابقون لامتلاكه

يقوم كل لاعب رئيسي بإعادة التفكير في البحث من خلال عدسة مساعدي الذكاء الاصطناعي - ولا تقتصر الرؤية على تقديم إجابات أفضل. بل يتعلق الأمر بالوكلاء الذين يتصرفون ويفهمون السياق ويتحركون عبر الطرائق.

تأخذ Google زمام المبادرة من خلال نهج متعدد الطبقات. يعمل نموذج Gemini الخاص بها على تشغيل كل شيء بدءًا من وضع الذكاء الاصطناعي إلى المشاريع التجريبية مثل Astra وMariner. ويُعد مشروع Mariner معبّرًا بشكل خاص: لم يعد الأمر مجرد بحث، بل أصبح عملًا. فبدلاً من النقر على مواقع الويب، يمكن للمستخدمين الآن أن يطلبوا من المساعد شراء تذاكر السفر أو التعامل مع طلب البقالة، ويتولى الوكيل الخطوات في الخلفية. تضع Google هذا الأمر في إطار تحوّل أساسي: نحن لا نبحث في المواقع الإلكترونية - نحن نفوض المهام إلى الوكلاء.

في الوقت الحالي، لا يزال تطبيق Mariner قيد الاختبار مع المستخدمين الأوائل من خلال اشتراك "AI Ultra"، ولكنه في طريقه للانتقال إلى وضع الذكاء الاصطناعي قريباً. من ناحية أخرى، تعمل Astra على إدخال الذكاء في الوقت الفعلي في كيفية فهم Google للعالم، سواء كان ذلك للإجابة عن سؤال حول شيء ما في عرض الكاميرا أو تعزيز التفاعلات الصوتية والفيديو المباشرة. ما بين Gemini Live و"وضع العميل" القادم في Chrome، من الواضح أن Google ترى أن البحث يتطور إلى شيء غامر - حيث يندمج كل من السؤال والتصفح والقيام بكل شيء في تدفق واحد، مدفوعًا بالذكاء الاصطناعي.

OpenAI ومايكروسوفت والوكلاء الدائمون

يتعامل OpenAI، المرتبط ارتباطًا وثيقًا بمايكروسوفت، مع نفس المشكلة من زاوية مختلفة قليلاً - المحادثة أولاً. حيث يجمع وضع البحث في ChatGPT بين التصفح المباشر للويب والحوار الطبيعي والاستشهادات، مما يحول نافذة الدردشة إلى طبقة بحث تفاعلية سلسة وتفاعلية. ولكنها لا تتوقف عند هذا الحد.

من خلال النموذج الأولي لوكيل المشغّل، تعمل OpenAI على بناء وكلاء لا يكتفون بالعثور على المعلومات فحسب، بل يقومون بمهام كاملة. فكر في: إرسال النماذج، وإجراء الحجوزات، وإنهاء عمليات الشراء - كل ذلك يتم في الخلفية. في عام 2025، أطلقوا "الوكلاء" كميزة أساسية: كيانات الذكاء الاصطناعي التي يمكنك تخصيصها للتصرف نيابةً عنك. يحتفظ هؤلاء الوكلاء بالذاكرة، ويفهمون صوتك أو علامتك التجارية، ويصلون إلى مجموعات بيانات محددة، ويديرون عمليات سير عمل مستمرة - حتى عندما لا تتفاعل معهم بشكل نشط.

ما يجلبه هؤلاء العملاء المثابرون إلى الطاولة:

- سياق التشغيل الدائم: تذكر الطلبات والتفضيلات والأساليب السابقة

- سير العمل الآلي: المهام التي بدأت بدون تعليمات يدوية خطوة بخطوة

- رؤى مصممة خصيصًا: تقديم اقتراحات محددة بدلاً من الاقتراحات العامة

ميتا ومايكروسوفت وأبل - وحروف البدل للشركات الناشئة

ميتا لا تجلس على الهامش. ففي عام 2025، وتحت إشراف زوكربيرج، أطلقت الشركة مختبرات Meta Superintelligence Labs - وهي مبادرة عالية المخاطر تهدف إلى دفع الذكاء الاصطناعي الفائق إلى الأمام. وهم يسعون وراء أفضل ما في الصناعة بقوة نارية كبيرة: ميزانيات بنية تحتية بمليارات الدولارات، وعروض تعويضات بملايين الدولارات، وقائمة توظيف تبدو وكأنها قائمة توظيف لكل نجوم الذكاء الاصطناعي.

بعض الأسماء التي استقطبوها؟ شينغجيا تشاو، أحد العقول التي تقف وراء ChatGPT، والذي يشغل الآن منصب كبير العلماء. ثم هناك مات ديتكي - يبلغ من العمر 24 عامًا فقط ويقال إنه تم استقدامه بحزمة $250 مليون دولار. ووفقاً لمصادر مطلعة، فإن زوكربيرج يحتفظ بقائمة حرفية لكبار باحثي الذكاء الاصطناعي الذين يريدهم - ويقدم عروضاً كبيرة بما يكفي لزعزعة الصناعة. إنه يعمل بالفعل. فقد استجابت OpenAI، على سبيل المثال، بمكافآت استبقاء قوية ومكافآت أسهم للاحتفاظ بالأشخاص الرئيسيين.

ولكن ميتا ليست وحدها. فقد دخلت مايكروسوفت في اللعبة مبكراً من خلال شراكتها مع OpenAI، حيث حولت Bing إلى محرك بحث يعتمد على الذكاء الاصطناعي أولاً قبل أن يلتحق الآخرون بهذا المجال. يمكن القول إن روبوت الدردشة الآلي الخاص ب Bing، مع إجابات في الوقت الفعلي واستشهادات من مصادرها، دفع Google إلى طرح SGE. كما قامت مايكروسوفت أيضًا بتضمين برنامج Copilot في نظام التشغيل Windows نفسه - حيث قامت بتضمين البحث في نظام التشغيل مباشرةً.

آبل، كالعادة، تلتزم الصمت، لكن التسريبات تشير إلى تحركات كبيرة: أجهزة LLM مخصصة، وعروض بحث محتملة بالذكاء الاصطناعي، ولعب طويل الأمد في البحث المجسد عبر أجهزة مثل سماعة Vision Pro.

ثم هناك الشركات الناشئة سريعة الحركة - مثل Perplexity وNeeva (وهي الآن جزء من Snowflake) وغيرهما - وكلها تختبر الاكتشاف القائم على الذكاء الاصطناعي أولاً الذي يتخطى الويب التقليدي بالكامل لصالح الإجابات المباشرة والملخصات الموثوقة.

البحث لم يعد ميزة بعد الآن - إنها الواجهة

لا أحد يمتلك مستقبل البحث بشكل مباشر. ولكن من الواضح ما هو الاتجاه الذي تسير فيه الأمور: سيكون البحث في كل مكان، وسيتم دمجه في كل شيء، وسيتم تشغيله بواسطة المساعدين. سواء كان ذلك وكلاء مهام جوجل، أو منطق المحادثة في OpenAI، أو التجارة التي تعتمد على الصوت من أمازون، أو الرسم البياني الاجتماعي الغني بالسياق من Meta - كلها تشير إلى نفس النتيجة.

لم يعد البحث قائمة ثابتة من الروابط. لقد أصبح حوارًا حيًا وسياقيًا. وبالنسبة للمبدعين والعلامات التجارية والمسوقين، فإن هذا يغير اللعبة. لن يكون الحصول على "العثور" على "البحث" متعلقًا بالترتيب #1 - بل سيكون متعلقًا بأن تصبح الإجابة الموثوقة التي يصل إليها الذكاء الاصطناعي. أو الأداة التي يختارها لإكمال مهمة ما.

إن صندوق البحث يتطور إلى شيء أكبر - نظام لا يكتفي بالعثور فقط، بل يفكر ويتصرف نيابةً عنك. وهل حان الوقت لبدء البناء لهذا المستقبل؟ إنه هنا بالفعل.

الأسئلة الشائعة

GEO - التحسين التوليدي للمحرك - يتعلق بإعداد المحتوى لاكتشاف الذكاء الاصطناعي أولاً، وليس فقط محركات البحث. مع مُحسّنات محرّكات البحث، أنت تعمل على تحسين تصنيفات الويب التقليدية. أما GEO فيتمحور حول التأكد من ظهور علامتك التجارية أو منتجك أو رؤيتك في الإجابات التي يولدها مساعدو الذكاء الاصطناعي - سواء كان ذلك صوتياً أو عبر الدردشة أو مدمجاً عبر الأجهزة. إنه ليس بديلاً عن تحسين محركات البحث، ولكنه بالتأكيد تحول في كيفية عمل الرؤية.

ليس تماماً - ولكن هذا يعني أن الكلمات المفتاحية لم تعد هي كل شيء بعد الآن. لا يبحث الذكاء الاصطناعي عن التطابق التام فقط. فهو ينظر إلى المعنى والقصد والسياق. لذا، نعم، لا تزال الكلمات المفتاحية مهمة، لكنها تحتاج إلى أن تكون موجودة داخل المحتوى الذي يجيب بالفعل على الأسئلة، ويحل المشاكل، ويعكس كيف يتحدث الناس بشكل طبيعي.

بالتأكيد، وفي بعض النواحي، تعمل GEO على تسوية ساحة اللعب. يقوم مساعدو الذكاء الاصطناعي بإعطاء الأولوية للمحتوى المفيد والملائم. إذا كانت إجابتك أفضل، فسيتم عرضها - حتى لو لم تكن الاسم الأكبر في المجال. ومع ذلك، لا يزال الظهور يتطلب هيكلة ذكية وإشارات واضحة وبيانات يمكن الوصول إليها. إنه ليس سحراً.

البيانات المهيكلة مهمة أكثر من أي وقت مضى. وكلاء الذكاء الاصطناعي لا "يقرأون" فقط مثل البشر، بل يقومون بالتحليل والتفسير والاتصال. إن تزويدهم بمحتوى نظيف ومنظم - سواء كان ذلك من خلال ترميز المخطط أو واجهات برمجة التطبيقات أو التنسيقات التي يمكن الوصول إليها - يزيد من فرص اختيارك أو الإشارة إليك أو التصرف بناءً عليه.